728x90

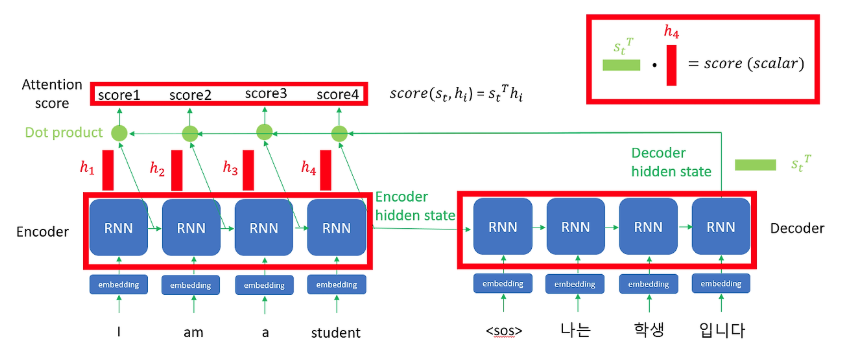

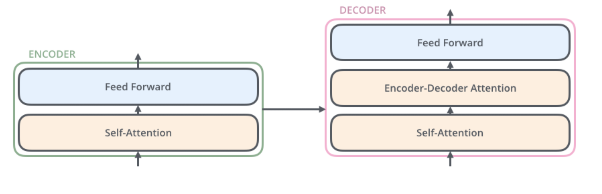

1. Encoder 와 Decoder

- Encoder: Input data를 받아 압축 데이터(context vector)로 변환 및 출력

- Decoder: Encoder와 반대로 압축 데이터(context vector)를 입력 받아 Output data를 출력

- 데이터를 압축하여 전달하는 이유는 정보를 압축하여 연산량을 최소화할 수 있기 때문

- 다만 압축하여 발생하는 정보 손실이 존재

- 정보 손실을 해결하기 위해 Attention이라는 개념이 도입됨

[NLP] Word Embedding

자연어처리 공부중입니다. 잘못된 부분은 편히 댓글 부탁드립니다.1. 워드 임베딩이란?단어를 인공신경망 학습을 통해 벡터화하는 하는 것즉 텍스트를 숫자로 변환하는 방법2. 희소 표현(Sparse Re

hello-heehee.tistory.com

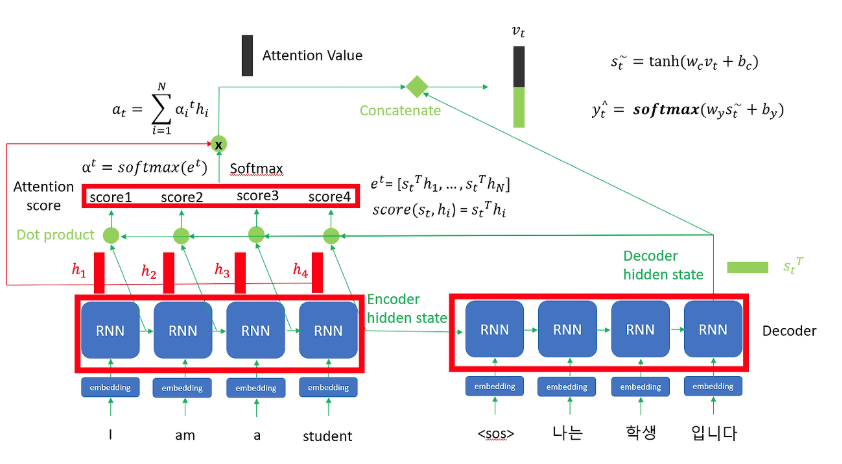

2. Attention Score

- Encoder는 모든 RNN 셀의 Hidden States들을 사용

- Decoder는 현재 RNN셀의 Hidden State만을 사용

- Encoder Hidden States와 전치한 ecoder Hidden States를 내적(dot product)하여 상수값인 Attention Score를 구함

- Attention Score는 RNN의 수 만큼 나오고 위 그림은 score1~score4까지 4개가 나옴

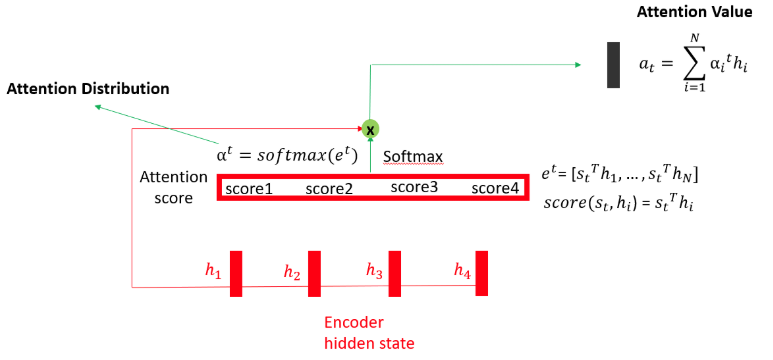

3. Attention Value

- Attention Score들을 Softmax 활성함수에 대입하여 Attention Distribution을 만들어 Score들의 중요도를 확인

[딥러닝 기초] 활성 함수(Activation Function) 정의 및 종류

: 뉴런의 출력값을 결정하는데 사용1. 역할비선형성 추가- 입력과 출력의 관계를 비선형으로 만들어 신경망이 복잡한 데이터 분포를 학습할수 있게 만듦- 비선형 함수가 없으면 여러 층의 뉴런

hello-heehee.tistory.com

- Hidden State의 Attention Score(중요도)를 반영하여 Attention Value를 구함

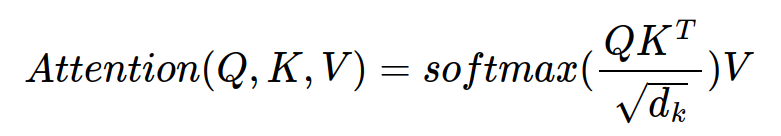

4. Attention

: 모델의 성능 향상을 위해 문맥(context)에 따라 집중(Attention)할 단어를 결정하는 방식

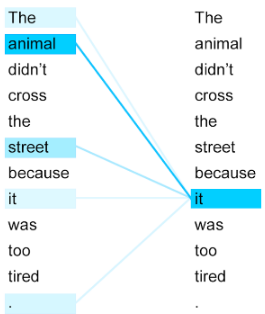

5. Self-Attention

: 문장에서 단어들의 연관성을 알기 위해 자기자신의 Attention을 계산

ex) 예를 들어, "The animal didn't cross the street because it was too tired." 여기서 대명사 it만으로는 절대 정확한 내용을 알 수 없다. 그렇기 때문에 문장 내 다른 단어들을 참고하여 그 뜻인 "animal" 알아낸다.

이 때 Self-Attention이 그 의미를 알아내는 역할을 한다.

728x90

'DeepLearning > NLP' 카테고리의 다른 글

| [NLP] Drain3 - Python (0) | 2025.02.19 |

|---|---|

| [NLP] 텍스트 데이터 전처리 - Log Template (3) | 2025.01.13 |

| [NLP] Transformer - BERT (4) | 2025.01.11 |

| [NLP] 텍스트 데이터 전처리 (3) | 2025.01.05 |

| [NLP] Word Embedding (4) | 2024.11.28 |